Inicialmente pude acompanhar o êxtase da sociedade em cima das possibilidades que a Inteligência Artificial apresentou neste primeiro momento em que fomos expostos a AI, isso impactou desde a otimização do tempo, a diminuição das falhas e a automação de processos!

Mas tecnicamente existem 3 tipos de Inteligência Artificial: E nós tivemos acesso apenas ao primeiro modelo!

Inteligência Artificial limitada (ANI)

A Inteligência Artificial Limitada, foi liberada para todos no ano passado e 95% dos processos que usam AI usam a (ANI) atualmente.

Este tipo de AI é conhecida como a “mais fraca”, e isso tem um motivo, ela apenas realiza o que foi programada para fazer, através de máquinas reativas! Quer um exemplo clássico de máquina reativa? O uso do Deep Blue da IBM que venceu Garry Kasparov em um duelo de xadrez em 1985. Sim, elas estão ativas desde a década de 80.

Mas este modelo evoluiu e hoje representa toda a Inteligência Artificial existente no mundo, incluindo até a mais complicada e capaz que já foi liberada! Essas máquinas não podem fazer nada além do que foram programadas para fazerem!

Inteligência Artificial Geral (AGI)

Agora, existe outro tipo de AI, a Inteligência Artificial Geral conhecida por (AGI), este modelo é uma AI mais humanizada, ou “nível humano”, já que ela é capaz de realizar tarefas similares às executadas pelos seres humanos!

Este tipo de Inteligência Artificial, não está disponível para que qualquer um possa usar, embora assim como o tipo anterior, a AGI também se divide, mas em dois tipos de inteligências:

- Máquinas cientes: aquelas que conseguem perceber o mundo ao seu redor e compreender os estímulos que recebem para processar as informações e tomarem decisões;

- Máquinas autoconscientes: aquelas que possuem consciência tanto do mundo quanto de si mesmas, aqui temos uma característica: a habilidade do agente de IA em aprender, perceber, compreender e funcionar completamente independente de programação humana!

Superinteligência Artificial (ASI)

Mas quando falamos em perigos da AI, precisamos falar do terceiro modelo da AI, a Superinteligência Artificial (ASI).

Diferente das demais, este modelo de AI é muito mais abrangente e restrito, apenas pessoas selecionadas como cientistas, governos e empresas privadas de grande porte, tem acesso a ela! Podendo variar desde um supercomputador superior à mente humana até uma entidade extremamente mais inteligente, e capaz de realizar tarefas impossíveis para os seres humanos!

O desenvolvimento da AGI e da ASI pode nos levar a um cenário conhecido como a Singularidade Tecnológica. Nesta hipótese, há uma relação entre o crescimento tecnológico desenfreado da super Inteligência Artificial a mudanças irreversíveis na civilização humana. E embora o potencial de ter máquinas tão poderosas à nossa disposição pareça “atraente”, essas máquinas também podem ameaçar nossa existência ou, pelo menos, nosso modo de vida como conhecemos.

O termo “singularidade” foi emprestado da Física pelo matemático e cientista da computação John von Neumann (1903-1957) quando em 1950 ao citar os avanços da época, cada vez mais acelerados da tecnologia ele usa o termo pela primeira vez.

A ele foi atribuída a seguinte citação:

“O progresso cada vez mais acelerado da tecnologia e as mudanças no modo de vida humano dão a impressão de que uma singularidade essencial na história da humanidade está se aproximando, além da qual as questões humanas, como as conhecemos, não poderiam continuar.”.

“The ever accelerating progress of technology and changes in the mode of human life give the appearance of approaching some essential singularity in the history of the race beyond which human affairs, as we know them, could not continue.”.

Essa teria sido a primeira vez que a palavra “singularidade” foi associada à alta tecnologia.

Por esse motivo, os debates científicos estão atualmente concentrados nessa forma de IA, pois ela tem o potencial de mudar tudo que conhecemos!

E cada um dos modelos de AI representa um nível diferente de eficiência, que define se elas são capazes de realizar tarefas simples ou complexas.

Riscos de Segurança e Privacidade

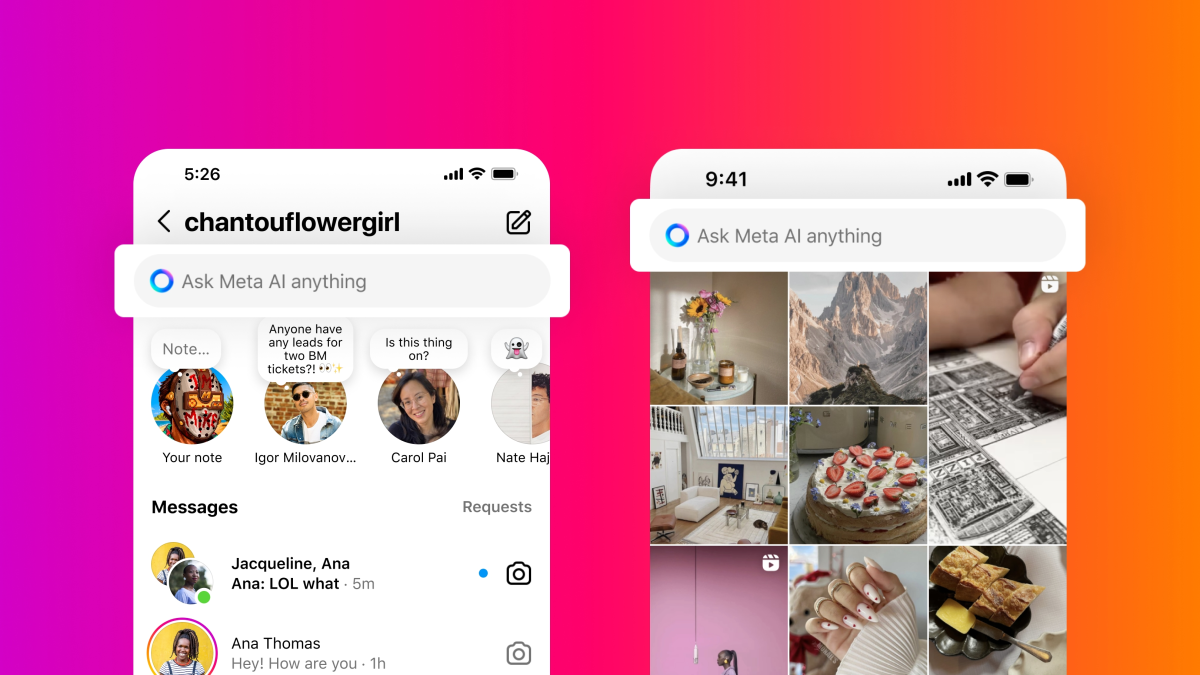

À medida que as tecnologias baseadas em Inteligência Artificial se tornam cada vez mais sofisticadas, os riscos de segurança associados aos seus usuários também aumentam. Porque as tecnologias baseadas em IA coletam e analisam grandes quantidades de dados pessoais, levantando questões relacionadas à privacidade e segurança.

Enquanto do lado coletivo, nós corremos o risco do desenvolvimento da Inteligência Artificial ser dominado por um pequeno número de grandes corporações e governos, seja para fins de controle ou militares! Por outro lado, a confiança excessiva em sistemas de IA também pode levar à perda de criatividade, habilidades de pensamento crítico e intuição humana.

A IA também cria o potencial de contribuir para a desigualdade econômica ao beneficiar desproporcionalmente indivíduos e corporações mais ricas. Para que este artigo não soe como “teoria da conspiração”, é sempre bom lembrar, que mais de mil pesquisadores e líderes de tecnologia no mundo inteiro, incluindo o cofundador da Apple, Steve Wozniak, pediram aos laboratórios de inteligência que interrompessem o desenvolvimento de sistemas avançados de IA .

A carta aberta, afirma que as ferramentas de IA apresentam “riscos profundos para a sociedade e a humanidade”. Dito isso, nós podemos nos concentrar no modelo mais simples da Inteligência Artificial, os benefícios todos já usam, desde Chatbots, Assistentes, Escrita de conteúdo ou Editor de imagens com AI.

Mas nós já estamos ao mesmo tempo sentindo de perto alguns problemas criados pelo uso indevido da AI. E um deles é o Deepfake!

Deepfake

O termo Deepfake é uma técnica que usa Inteligência Artificial que precisa de banco de dados de imagens e áudios para inserir pessoas em vídeos que não participaram da gravação real.

A técnica, também pode ser usada de maneira mais simples, como a criação, complemento ou idealização cenas em fotografias, técnica que já foi utilizada com a ajuda de alguns softwares para disseminar nudez falsa através de fotos de pessoas reais, que utilizam estas imagens criadas pela AI para chantagear estas pessoas depois.

Hackers, utilizam esta técnica para enganar os usuários com um modelo de chantagem pessoal, ou a grandes corporações, um meio de prevenção, é entender como a segurança digital pode te ajudar a se prevenir contra este tipo de ameaça digital.

Conheça o Curso de Segurança Digital do CanalJMS

As imagens e vídeos adulterados também são usadas na política, e nas redes sociais, e o grande problema é o desconhecimento e a facilidade de manipulação a que a maioria das pessoas são expostas.

O Compartilhamento de tudo

As pessoas, também tem seu lado de erro nesta história, porque elas compartilham tudo que veem! Este é um ponto que me chama atenção, ver que as pessoas compartilham certas informações que veem nas redes sociais como se fosse verdade, sem sequer, verificar a veracidade daquela informação! As pessoas já tendem a acreditar no que ouvem, imagina no que elas veem e ouvem, mesmo que seja algo falso!

Já pensou em ver o seu rosto em um vídeo que você não gravou ou, pior ainda, ouvir sua própria voz dizendo coisas que você jamais diria?

Ou mesmo se deparar com fotos que você aparece com outras pessoas em situações que você não estava? O problema é quem, vai poder afirmar que é verdade ou mentira? Por causa disso, pesquisadores já estariam estudando um meio, de “verificação de realidade“, que pode aparecer antes do que imaginamos!

E até que você tente amenizar os problemas gerados por este tipo de tecnologia, a IA nas mãos das pessoas erradas, pode criar problemas, inimagináveis!

Grupo Whatsapp

Grupo Whatsapp

Grupo Telegram

Grupo Telegram

[…] planos da OpenAI envolvem o desenvolvimento de uma Inteligência Artificial Geral (AGI), ou como tem sido chamada, uma “super IA” que será tão inteligente quanto os humanos. […]

[…] Os Perigos da Inteligência Artificial […]

[…] pelos reguladores à Tesla na fábrica do Texas em 2021 ou 2022, mas o incidente aumenta as preocupações sobre os riscos dos robôs automatizados no […]